Berkenalan dengan RAG: Teknologi AI yang Mengubah Cara Mesin Memberikan Jawaban

Masta

1.2k Views

"Retrieval-Augmented Generation adalah sebuah pendekatan arsitektur AI yang menggabungkan kekuatan model bahasa besar dengan kemampuan untuk mengakses dan mengambil data eksternal secara real-time. Bayangkan seorang ahli yang tidak hanya mengandalkan pengetahuan di kepalanya, tetapi juga rajin membuka buku referensi, database, dan dokumen terkini sebelum menjawab pertanyaan Anda—itulah esensi dari RAG."

Di era digital yang terus berkembang pesat, teknologi kecerdasan buatan (AI) menghadapi tantangan besar: bagaimana memberikan informasi yang akurat, terkini, dan relevan tanpa harus terus-menerus melatih ulang model dari nol? Jawabannya terletak pada sebuah inovasi bernama Retrieval-Augmented Generation atau disingkat RAG.

Teknologi ini menjadi semakin populer di kalangan pengembang AI dan perusahaan teknologi karena kemampuannya mengatasi keterbatasan model bahasa besar (Large Language Models/LLM) konvensional. Mari kita menyelami lebih dalam tentang apa sebenarnya RAG, bagaimana cara kerjanya, dan mengapa teknologi ini menjadi game-changer dalam dunia AI.

Memahami RAG: Perpaduan Cerdas antara Pencarian dan Generasi

Retrieval-Augmented Generation adalah sebuah pendekatan arsitektur AI yang menggabungkan kekuatan model bahasa besar dengan kemampuan untuk mengakses dan mengambil data eksternal secara real-time. Bayangkan seorang ahli yang tidak hanya mengandalkan pengetahuan di kepalanya, tetapi juga rajin membuka buku referensi, database, dan dokumen terkini sebelum menjawab pertanyaan Anda—itulah esensi dari RAG.

Teknologi ini pertama kali dikembangkan oleh tim peneliti dari Facebook AI Research (kini Meta AI) dengan tujuan menghubungkan LLM dengan sumber-sumber eksternal yang kaya akan informasi teknis terbaru dan spesifik. Berbeda dengan LLM standar yang hanya bergantung pada data pelatihan yang sudah "beku" pada waktu tertentu, RAG mampu menyuntikkan konteks baru dari berbagai sumber seperti basis pengetahuan perusahaan, database internal, artikel terkini, atau dokumen proprietary.

Kerangka kerja hybrid ini memungkinkan sistem AI untuk tetap relevan dengan perkembangan terbaru tanpa memerlukan biaya dan waktu yang besar untuk melatih ulang seluruh model. Inilah yang membuat RAG menjadi solusi yang sangat skalabel dan efisien, terutama untuk organisasi yang memiliki data internal yang terus berkembang.

Cara Kerja RAG: Proses di Balik Layar

Untuk memahami kehebatan RAG, penting untuk mengetahui bagaimana teknologi ini bekerja. Prosesnya mungkin terdengar kompleks, tetapi sebenarnya dirancang untuk berjalan dengan sangat efisien—umumnya hanya membutuhkan waktu 1-2 detik untuk menghasilkan respons dalam antarmuka percakapan.

Tahap Pertama: Persiapan dan Pengindeksan Dokumen

Sebelum sistem RAG dapat bekerja, data eksternal yang akan digunakan harus disiapkan terlebih dahulu. Dokumen-dokumen seperti manual produk, kebijakan perusahaan, artikel pengetahuan, atau database informasi dipecah menjadi potongan-potongan kecil yang lebih mudah dikelola (chunks).

Potongan-potongan ini kemudian dikonversi menjadi representasi numerik yang disebut vektor atau embedding menggunakan model khusus seperti BERT atau model embedding lainnya. Proses ini mengubah teks menjadi serangkaian angka yang menangkap makna semantik dari konten tersebut. Vektor-vektor ini kemudian disimpan dalam database vektor khusus yang dirancang untuk pencarian semantik berkecepatan tinggi.

Tahap Kedua: Penerimaan dan Analisis Query

Ketika pengguna mengajukan pertanyaan atau permintaan, sistem tidak langsung mengirimkannya ke LLM. Query pengguna juga dikonversi menjadi vektor dengan cara yang sama seperti dokumen-dokumen sebelumnya. Ini memungkinkan sistem untuk membandingkan "makna" dari pertanyaan dengan "makna" dari dokumen yang tersimpan.

Tahap Ketiga: Pengambilan Informasi Relevan

Inilah bagian "Retrieval" dalam RAG. Sistem melakukan pencarian semantik di database vektor untuk menemukan dokumen atau potongan informasi yang paling relevan dengan query pengguna. Pencarian ini menggunakan teknik dense retrieval yang mengukur kesamaan semantik antara vektor query dengan vektor dokumen, bukan sekadar mencocokkan kata kunci.

Misalnya, jika pengguna bertanya "Bagaimana cara mengajukan cuti?", sistem akan menemukan dokumen yang membahas prosedur pengajuan cuti meskipun dokumen tersebut mungkin menggunakan istilah berbeda seperti "permohonan izin" atau "leave application".

Tahap Keempat: Augmentasi dan Generasi Respons

Setelah informasi relevan ditemukan, sistem melakukan "augmentasi" dengan menggabungkan informasi tersebut ke dalam prompt yang akan dikirim ke LLM. Jadi, LLM tidak hanya menerima pertanyaan asli pengguna, tetapi juga konteks tambahan dari dokumen yang relevan.

Dengan konteks yang diperkaya ini, LLM kemudian menghasilkan respons yang koheren, akurat, dan berbasis pada informasi faktual dari sumber eksternal. Hasilnya adalah jawaban yang tidak hanya gramatikal dan alami, tetapi juga grounded pada data terkini dan terverifikasi.

Keunggulan dan Manfaat RAG dalam Praktik

RAG hadir untuk mengatasi berbagai keterbatasan yang selama ini menjadi tantangan dalam penggunaan AI generatif, terutama LLM konvensional. Berikut adalah manfaat utama yang membuat RAG semakin banyak diadopsi:

1. Informasi Selalu Terkini dan Akurat

Salah satu kelemahan terbesar LLM standar adalah ketergantungan pada data pelatihan yang memiliki batas waktu (cut-off date). Model seperti GPT-3 atau GPT-4 hanya "mengetahui" informasi hingga tanggal tertentu saat mereka dilatih. Setelah itu, mereka tidak memiliki akses ke perkembangan atau peristiwa terbaru.

RAG mengatasi masalah ini dengan mengakses data eksternal yang dapat diperbarui kapan saja. Perusahaan dapat terus menambahkan dokumen baru, update kebijakan, atau informasi produk terkini ke dalam database vektor tanpa harus melatih ulang model AI-nya. Ini membuat sistem selalu relevan dengan kondisi terkini.

2. Mengurangi Halusinasi AI

"Halusinasi" dalam konteks AI merujuk pada fenomena ketika model menghasilkan informasi yang terdengar meyakinkan tetapi sebenarnya salah atau tidak berdasar. Ini terjadi karena LLM kadang "membuat-buat" jawaban ketika tidak memiliki informasi yang cukup, namun tetap berusaha memberikan respons yang koheren.

RAG secara signifikan mengurangi risiko ini dengan meng-ground atau mendasarkan respons pada data faktual dari sumber eksternal. Karena jawaban didasarkan pada dokumen nyata yang diambil dari database, kemungkinan model "mengarang" informasi menjadi jauh lebih kecil. Sistem dapat memberikan jawaban yang lebih dapat dipercaya dan terverifikasi.

3. Spesialisasi untuk Domain Tertentu

Setiap industri dan organisasi memiliki pengetahuan spesifik yang tidak tersedia secara publik. Manual internal, prosedur operasional, kebijakan perusahaan, atau dokumentasi teknis proprietary adalah contoh informasi yang sangat penting tetapi tidak terdapat dalam data pelatihan LLM umum.

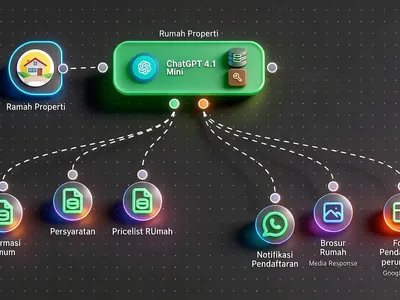

RAG memungkinkan organisasi untuk membangun sistem AI yang ahli dalam domain mereka sendiri tanpa harus membagikan data sensitif untuk pelatihan model publik. Customer support dapat mengakses basis pengetahuan internal, chatbot HR dapat menjawab pertanyaan tentang kebijakan perusahaan, dan asisten teknis dapat merujuk dokumentasi produk terkini—semuanya dengan akurasi tinggi.

4. Efisiensi Biaya yang Signifikan

Melatih atau melakukan fine-tuning pada LLM besar memerlukan sumber daya komputasi yang sangat besar dan mahal. Prosesnya juga memakan waktu dan membutuhkan keahlian teknis tingkat tinggi. Setiap kali ada update informasi, proses ini harus diulang.

Dengan RAG, organisasi cukup memperbarui database pengetahuan eksternal tanpa menyentuh model AI itu sendiri. Ini drastis mengurangi biaya operasional dan teknis. Update informasi bisa dilakukan dalam hitungan menit, bukan hari atau minggu yang diperlukan untuk retrain model.

5. Transparansi dan Penelusuran Sumber

Karena RAG mengambil informasi dari dokumen spesifik, sistem dapat melacak dari mana jawaban berasal. Ini memberikan transparansi yang sangat penting dalam aplikasi bisnis kritis. Pengguna dapat melihat sumber informasi yang digunakan untuk menghasilkan jawaban, meningkatkan kepercayaan dan memudahkan verifikasi.

Perbedaan Fundamental: RAG vs AI/LLM Konvensional

Untuk benar-benar memahami nilai RAG, penting untuk membandingkannya dengan pendekatan AI generatif konvensional:

Sumber Pengetahuan

LLM standar seperti ChatGPT atau Claude hanya mengandalkan pengetahuan yang tertanam dalam parameter model mereka selama proses pelatihan. Pengetahuan ini bersifat statis dan terbatas pada data yang tersedia hingga tanggal cut-off tertentu.

RAG, di sisi lain, mengkombinasikan pengetahuan bawaan model dengan kemampuan untuk mengambil informasi dari sumber eksternal secara dinamis. Model tidak hanya "mengingat" apa yang dipelajarinya, tetapi juga "mencari" informasi terbaru saat dibutuhkan.

Fleksibilitas Update

Ketika ada informasi baru yang perlu diintegrasikan, LLM konvensional memerlukan proses retrain atau fine-tuning yang memakan waktu dan biaya. Bahkan untuk update kecil, prosesnya bisa memakan waktu berhari-hari atau berminggu-minggu.

Sistem RAG dapat diupdate dengan mudah—cukup tambahkan dokumen baru ke database vektor. Perubahan langsung terasa pada interaksi berikutnya, tanpa downtime atau proses pelatihan ulang yang rumit.

Akurasi dan Keandalan

LLM standar rentan terhadap halusinasi, terutama ketika ditanya tentang topik yang kurang terwakili dalam data pelatihannya atau tentang peristiwa setelah cut-off date-nya. Model mungkin memberikan jawaban yang terdengar meyakinkan tetapi tidak akurat.

RAG meningkatkan akurasi dengan mendasarkan jawaban pada dokumen nyata. Jika informasi tidak ada dalam database, sistem dapat mengindikasikan ketidakpastian daripada "mengarang" jawaban.

Penerapan Domain Spesifik

Untuk membuat LLM ahli dalam domain tertentu, diperlukan fine-tuning dengan ribuan atau bahkan jutaan contoh data yang sudah dilabeli. Prosesnya kompleks dan memerlukan keahlian machine learning tingkat lanjut.

RAG memungkinkan spesialisasi domain hanya dengan mengumpulkan dokumen relevan dalam format yang mudah dibaca. Tidak perlu data berlabel atau proses training khusus—sistem langsung dapat memanfaatkan pengetahuan dari dokumen tersebut.

Biaya Operasional

Biaya untuk melakukan fine-tuning LLM bisa mencapai puluhan hingga ratusan juta rupiah, tergantung ukuran model dan jumlah data. Ini belum termasuk biaya infrastruktur komputasi yang diperlukan.

RAG jauh lebih ekonomis karena hanya memerlukan penyimpanan database vektor dan biaya inferensi model embedding yang relatif ringan. Untuk banyak organisasi, ini membuat AI tingkat enterprise menjadi lebih terjangkau.

Kapan Sebaiknya Menggunakan RAG?

Pemilihan antara RAG, fine-tuning, atau LLM standar tergantung pada kebutuhan spesifik aplikasi Anda:

Gunakan RAG ketika:

- Data Anda sering berubah atau diperbarui (berita, kebijakan, produk)

- Anda memiliki basis pengetahuan internal yang besar dan proprietary

- Akurasi faktual sangat penting (customer support, legal, medis)

- Budget terbatas untuk training atau fine-tuning model besar

- Anda perlu transparansi tentang sumber informasi

- Implementasi harus cepat tanpa proses training yang panjang

Gunakan Fine-tuning ketika:

- Anda membutuhkan adaptasi gaya bahasa atau tone yang sangat spesifik

- Tugas Anda sangat terspesialisasi dan tidak berubah sering

- Anda memiliki dataset berlabel yang besar dan berkualitas

- Performa pada tugas tertentu lebih penting dari fleksibilitas update

Gunakan LLM standar ketika:

- Tugas bersifat umum dan tidak memerlukan pengetahuan khusus

- Tidak ada kebutuhan untuk informasi terkini atau domain-specific

- Anda hanya memerlukan kemampuan generasi bahasa dasar

Dalam banyak kasus, pendekatan hybrid yang mengkombinasikan RAG dengan fine-tuning ringan memberikan hasil terbaik—model yang disesuaikan dengan gaya dan kebutuhan spesifik, namun tetap dapat mengakses informasi terkini.

Tantangan dan Pertimbangan dalam Implementasi RAG

Meskipun RAG menawarkan banyak keunggulan, ada beberapa aspek yang perlu diperhatikan dalam implementasinya:

Kualitas Database Pengetahuan

Sistem RAG hanya sebaik data yang ada dalam database-nya. Jika dokumen yang disimpan tidak akurat, usang, atau tidak terorganisir dengan baik, respons yang dihasilkan juga akan bermasalah. Kurasi dan pemeliharaan database pengetahuan menjadi kunci kesuksesan implementasi RAG.

Pemilihan Chunk Size yang Tepat

Memecah dokumen menjadi potongan-potongan yang terlalu kecil bisa kehilangan konteks penting, sementara chunk yang terlalu besar bisa membuat retrieval kurang presisi. Menemukan ukuran optimal memerlukan eksperimen dan penyesuaian berdasarkan karakteristik data Anda.

Latency dan Performa

Meskipun RAG umumnya cepat (1-2 detik), proses retrieval menambah latency dibanding LLM standar. Untuk aplikasi yang memerlukan respons real-time sangat cepat, ini bisa menjadi pertimbangan.

Kompleksitas Infrastruktur

Implementasi RAG memerlukan komponen tambahan seperti database vektor (Pinecone, Weaviate, Chroma), model embedding, dan orchestration layer. Ini menambah kompleksitas sistem dibanding menggunakan LLM API sederhana.

Masa Depan RAG dan AI Kontekstual

Teknologi RAG terus berkembang dengan cepat. Penelitian terkini mengeksplorasi berbagai pengembangan menarik:

Multimodal RAG yang tidak hanya mengambil teks, tetapi juga gambar, video, dan audio untuk konteks yang lebih kaya. Ini membuka kemungkinan aplikasi yang lebih luas, dari analisis medis hingga e-commerce visual.

Hierarchical Retrieval yang menggunakan pendekatan berlapis untuk pencarian lebih efisien dan akurat, dengan retrieval kasar diikuti refinement bertahap.

Self-Reflective RAG di mana sistem dapat mengevaluasi kualitas dokumen yang diambil dan memutuskan apakah perlu pencarian tambahan atau sudah cukup untuk menghasilkan jawaban berkualitas.

Adaptive RAG yang dapat menyesuaikan strategi retrieval-nya berdasarkan jenis pertanyaan—beberapa query mungkin memerlukan lebih banyak konteks, sementara yang lain cukup dengan dokumen minimal.

Kesimpulan

Retrieval-Augmented Generation merepresentasikan evolusi penting dalam pengembangan AI yang lebih andal, akurat, dan adaptif. Dengan menggabungkan kekuatan generatif LLM dengan kemampuan mengakses pengetahuan eksternal, RAG mengatasi banyak keterbatasan fundamental dari AI generatif konvensional.

Bagi organisasi dan pengembang, RAG menawarkan jalan tengah yang ideal: kemampuan AI tingkat enterprise tanpa biaya dan kompleksitas fine-tuning besar-besaran. Ini memungkinkan implementasi yang lebih cepat, lebih murah, dan lebih mudah di-maintain, sambil tetap memberikan respons yang akurat dan kontekstual.

Di era di mana data terus berkembang dengan kecepatan eksponensial dan kebutuhan akan informasi yang akurat semakin kritis, RAG bukan hanya sekadar inovasi teknis—ia adalah fondasi penting untuk membangun sistem AI yang benar-benar dapat dipercaya dan bermanfaat dalam kehidupan nyata.

Apakah Anda seorang pengembang yang ingin membangun chatbot perusahaan, data scientist yang merancang sistem knowledge management, atau decision maker yang mempertimbangkan investasi AI, memahami RAG dan potensinya adalah langkah penting untuk memanfaatkan kekuatan AI secara optimal di masa depan.

Share this article:

Trending Now

Membangun Chatbot Whatsapp Berbasis Menu

Agentic Chatbot : Chatbot yang tidak hanya sekedar membalas otomatis tapi bisa melakukan aksi

Berkenalan dengan RAG: Teknologi AI yang Mengubah Cara Mesin Memberikan Jawaban

OpenAI Meluncurkan GPT-5.2: Revolusi Baru dalam Era Kecerdasan Buatan Terapan